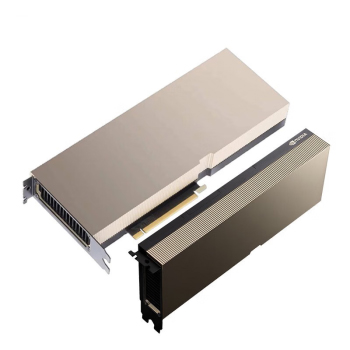

最近不少客户在问A100、V100、H100这仨显卡选哪个好。说实话,选显卡这事儿,得看你具体干嘛用。比如A100,现在15万左右的价格,性价比还是不错的。它用的Ampere架构,算力比V100强了不少,特别适合AI训练和大模型推理。

架构和性能对比

V100虽说老了点,但是是价格便宜啊,现在市面上二手货挺多的。如果预算有限,又想搞点简单的AI项目,V100也是个选择。不过呐,它的Tensor Core比A100少了一半,训练速度上差距还是挺明显的。

H100就更高端了,整机价格在220万左右。它用的是Hopper架构,专为大模型训练设计的。如果你要做ChatGPT那种级别的项目,H100绝对是首选。它的NVLink带宽比A100高了50%,多卡协同效率相当给力。

价格波动要注意

说到价格,最近显卡市场波动挺大的。尤其是H100,由于供货紧张,现货渠道的价格可能还会涨。建议大家在采购时多关注期货价格,提前锁定货源。另外呀,记得要选正规渠道,别贪便宜买拆机件,后期维护很麻烦。

实际应用场景

选显卡最重要的是匹配需求。比如做AI绘画,A100就够用了;要是搞自动驾驶模型训练,那还是得上H100。另外,还要考虑电费成本。H100的TDP是700W,算上散热,一台机器一年电费就得小十万,这笔账得算清楚。

总之吧,选显卡不能光看参数,得结合预算、需求和维护成本综合考虑。